経営情報システム

最優先データ分析技術と活用(BIツール、ビッグデータ、統計解析、可視化)

BI、ビッグデータ、統計解析、可視化、データ活用基盤を最厚で扱う。

この章で覚えておきたいこと

- BIは意思決定支援 です。業務データを集計、分析、可視化し、経営判断に使う仕組みを指します。

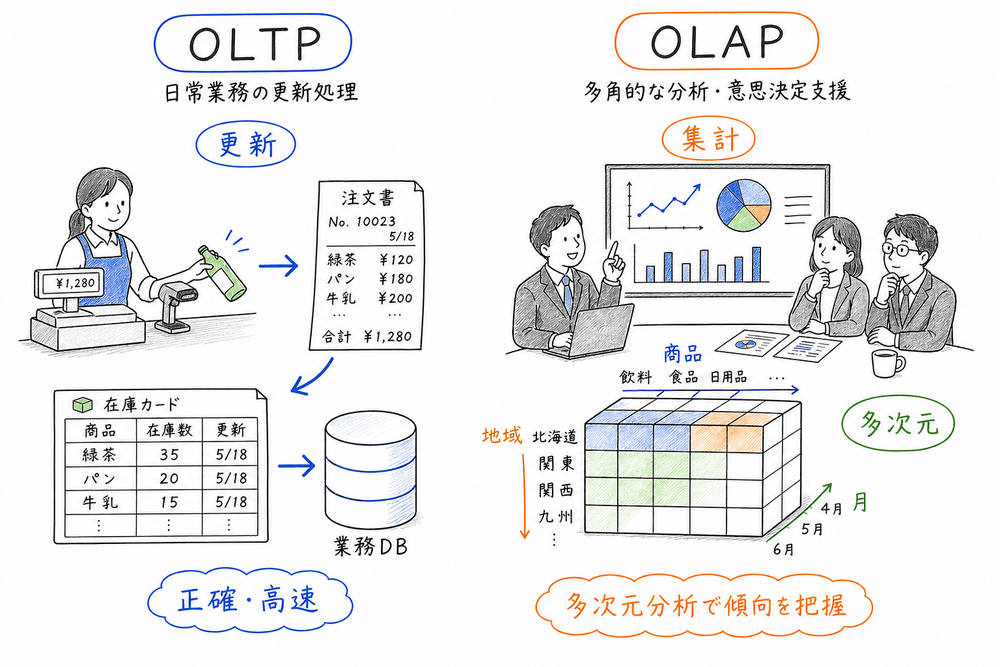

- DWHは分析用の統合倉庫 です。日常業務の更新処理を担うOLTPとは役割が違います。

- データマートは用途別の切り出し、データレイクは生データ置き場、データスワンプは管理不全の状態 と整理します。

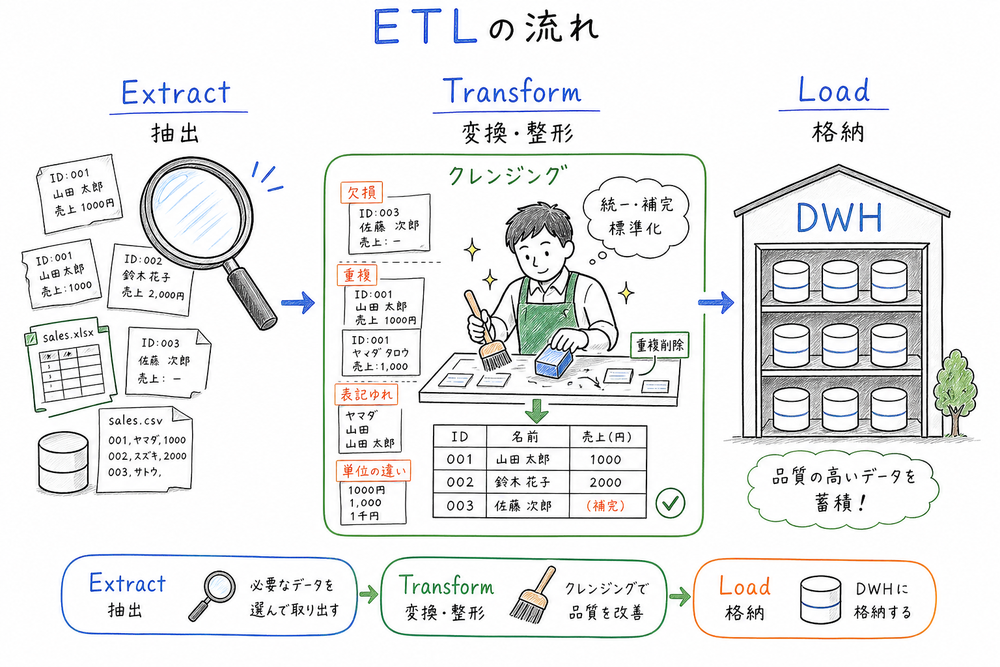

- ETLは抽出、変換、格納、データクレンジングは品質改善 です。似ていますが役割は同じではありません。

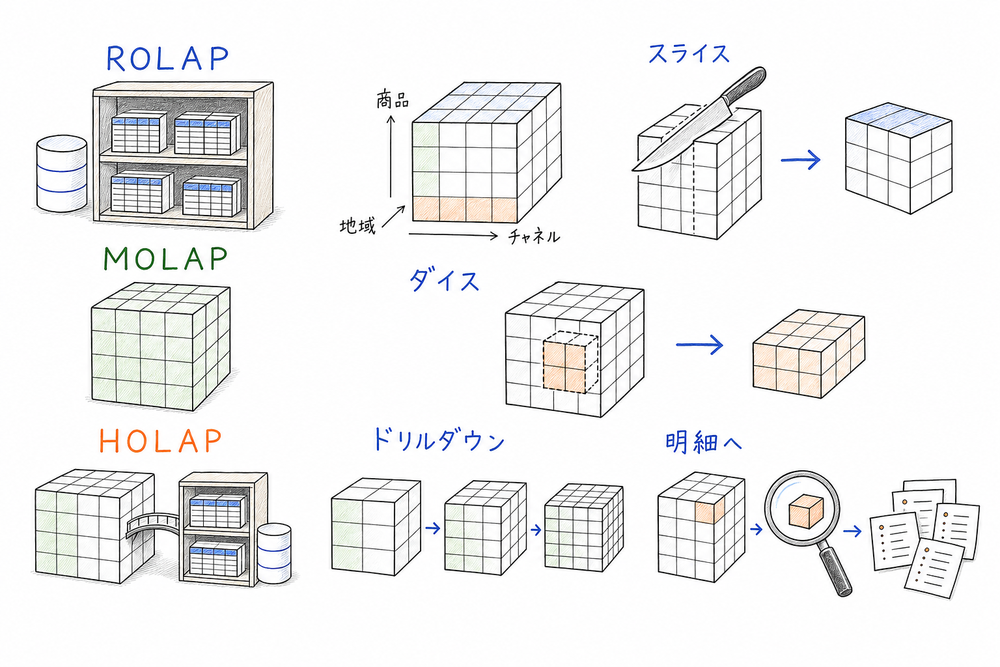

- OLTPは業務処理、OLAPは分析処理 です。ROLAP、MOLAP、HOLAPと、スライシング、ダイシング、ドリルダウンなどの操作も頻出です。

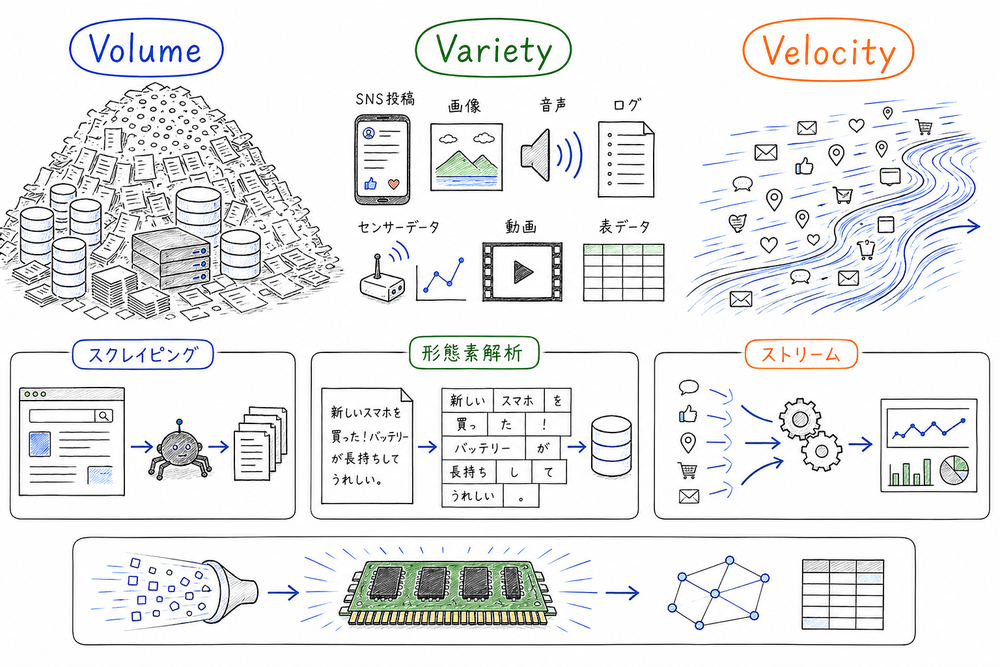

- ビッグデータは3V で整理します。量だけでなく、多様性と発生速度まで含めて理解します。

- 統計解析は、何を知りたいかで手法を選ぶ ことが重要です。平均差、関係性、予測、分類、施策比較を区別します。

- 仮説検定では、帰無仮説、有意水準、第1種の過誤、第2種の過誤 を正確に覚えます。

- 可視化では、どのグラフで何を読み取るか が問われます。最頻値と中央値の読み取りも典型です。

基本知識

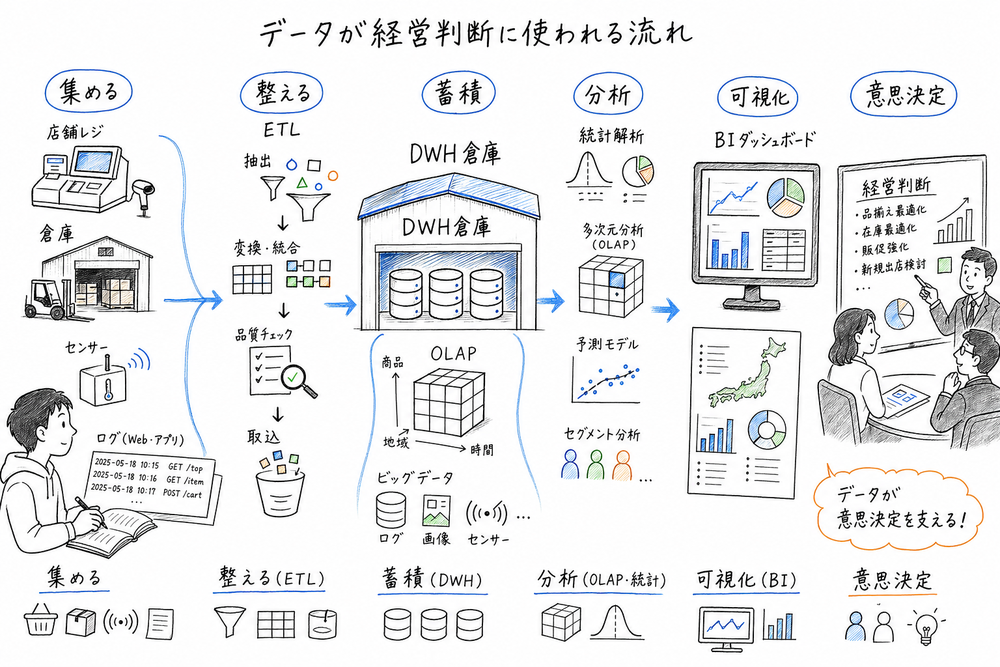

データ活用基盤の全体像

データ分析の問題では、まず「どこにデータを置くのか」「どのように整えるのか」「どう分析するのか」を分けて考えると整理しやすいです。典型的な流れは次のとおりです。

- 業務システム、Web、IoT、外部データから情報を集めます。

- ETLで抽出、変換、格納を行います。

- DWH、データマート、データレイクなどへ蓄積します。

- データクレンジングや前処理で品質を整えます。

- BIツール、OLAP、統計解析、可視化で意思決定に使います。

試験では、この流れのどの位置にある技術なのかを問う問題が多いです。用語だけで覚えるのではなく、入口、置き場、整備、分析のどれに当たるかで判定できるようにしておくと強いです。

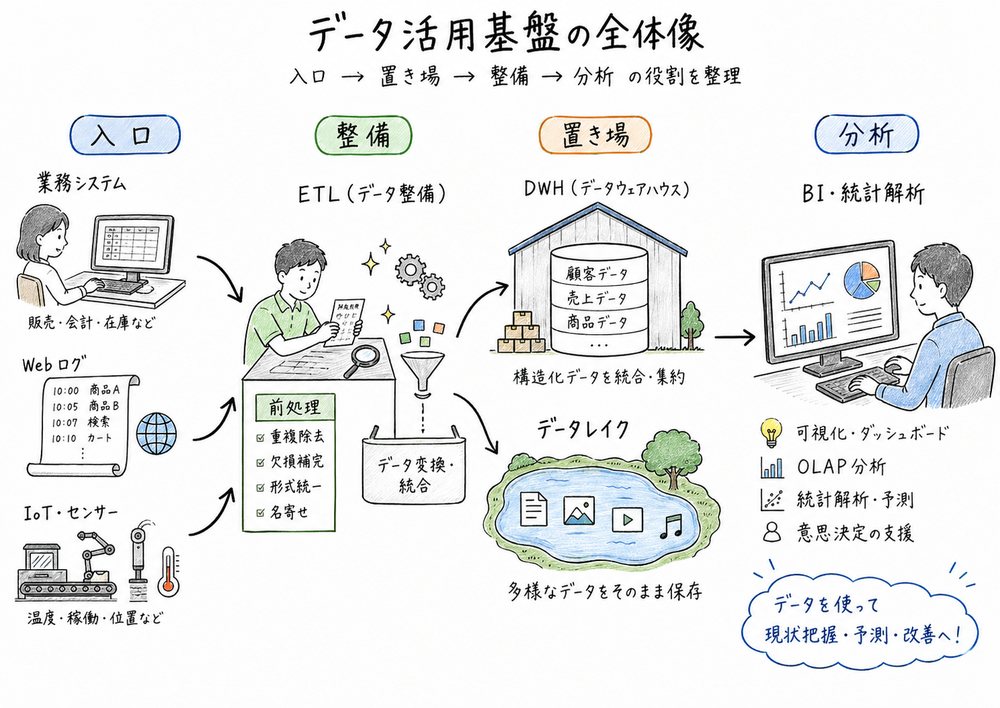

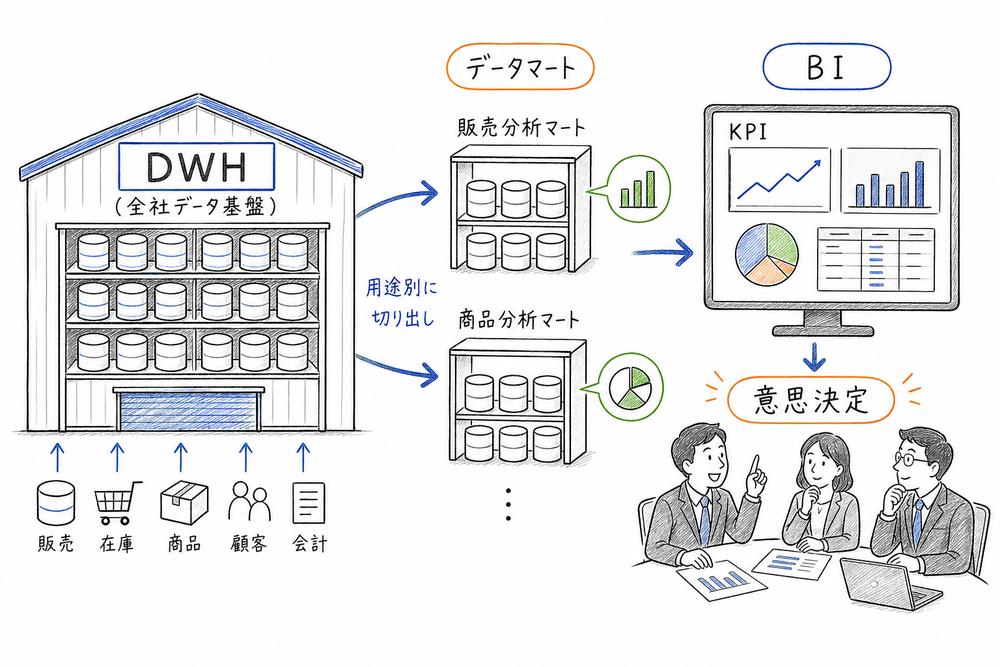

BIとDWH、データマート

BIは、企業内外のデータを分析し、経営上の意思決定に役立てる考え方や仕組みです。ダッシュボード、レポート、KPI監視、傾向把握などが代表例です。AIアルゴリズムの開発専用ツールではありません。

DWHは、分析に使いやすいようにデータを整理、統合して蓄積する分析用データベースです。代表的な特徴は次の4つです。

- 主題志向: 商品、顧客、売上など分析テーマごとに整理します。

- 統合: 複数システムのコードや表記の違いをそろえます。

- 時系列性: 過去からの履歴を蓄積し、推移を見られるようにします。

- 非更新: 日常業務の頻繁な更新よりも、読み出しと分析を重視します。

データマートは、DWHから部門別や用途別に必要なデータを切り出した小規模な分析用データ集合です。営業部門向け、商品分析向けなど、利用目的を絞って使います。

したがって、DWHは企業全体の分析基盤、データマートはその一部を使いやすくした部分集合と考えると整理できます。

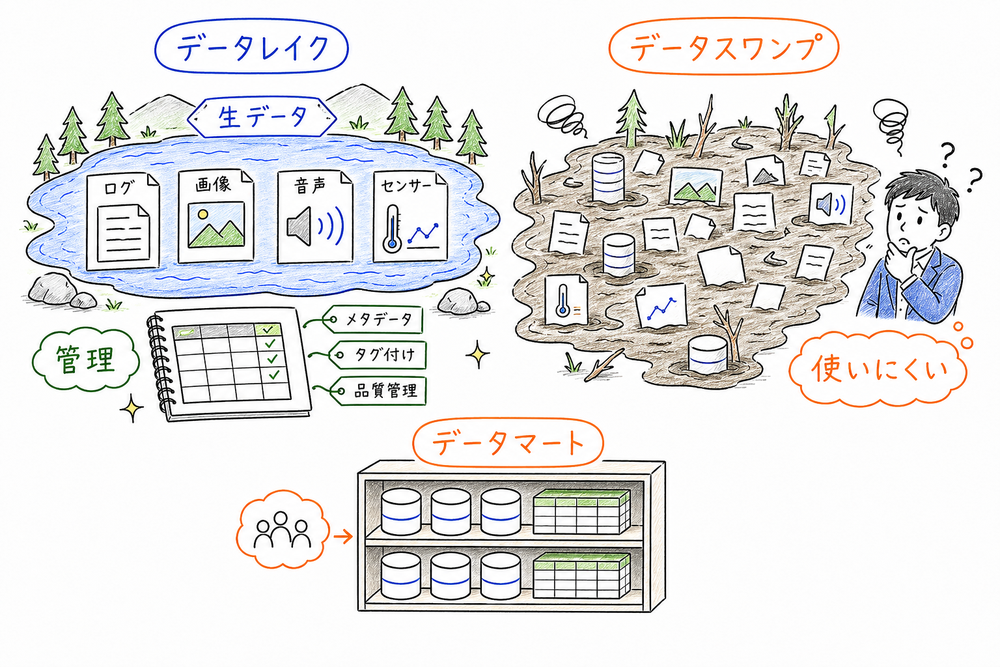

データレイクとデータスワンプ

データレイクは、構造化データだけでなく、ログ、画像、音声、動画、SNS投稿、IoTデータなども含めて、多様なデータを生に近い形で蓄積する基盤です。DWHのように最初から厳密な分析用スキーマへ整えてから入れるとは限りません。

データレイクの利点は、後から多様な分析に使いやすいことです。一方で、管理が甘いと何がどこにあるか分からなくなります。この状態をデータスワンプといいます。

区別は次のように押さえます。

- データレイク: 多様な生データを柔軟に蓄積する場所です。

- データスワンプ: データレイクが管理不十分で使い物になりにくくなった状態です。

- データマート: DWHから用途別に切り出した整理済みデータです。

近年はデータレイクとデータスワンプの違いが問われやすく、2025年の横断補足でも重要度が上がっています。

ETLとデータクレンジング

ETLは、Extract、Transform、Load の略です。

- Extract: 元データを抽出します。

- Transform: 分析しやすい形へ変換します。

- Load: DWHなどへ格納します。

ETLは、データを分析基盤へ載せるための一連の処理です。一方、データクレンジングは、欠損値、重複、表記揺れ、単位違い、異常値などを点検し、品質を整えることに重点があります。

両者の関係は次のように理解すると混同しません。

- ETLは流れ全体です。

- データクレンジングは、主にTransformの中で行う品質改善作業です。

試験では、ETLを予測手法のように書いたり、データクレンジングを多次元分析そのもののように書いたりする誤りがよく出ます。

OLTPとOLAP

OLTPは、受注入力、会計記帳、在庫更新など、日常業務のトランザクション処理を行う仕組みです。正確性、同時実行性、更新の速さが重視されます。

OLAPは、蓄積済みデータを多次元的に集計、比較、分析する仕組みです。売上を商品別、地域別、月別に見たり、階層を変えて掘り下げたりするときに使います。

この2つは目的が異なります。

- OLTP: 業務を回すための処理です。

- OLAP: 意思決定のための分析です。

「日々の更新処理」と書かれていればOLTP寄りです。「多次元分析」「集計」「傾向把握」と書かれていればOLAP寄りです。

ROLAP、MOLAP、HOLAPとOLAP操作

OLAPの実現方式は、どこにデータを置き、どの程度事前集計するかで区別します。

- ROLAP: リレーショナルデータベース上で多次元分析を行います。既存RDBを活用しやすい一方、複雑な集計では遅くなりやすいです。

- MOLAP: 多次元キューブに集計済みデータを保持します。応答は速いですが、事前集計や記憶領域が必要です。

- HOLAP: ROLAPとMOLAPを組み合わせた方式です。

操作も頻出です。

- スライシング: ある1条件で切って一部を取り出します。

- ダイシング: 複数条件で切り分けたり、切り口を変えたりします。

- ドリルダウン: 年から月、地域から店舗のように、より細かい階層へ掘り下げます。

- ドリルアップ または ロールアップ: 細かい情報を上位階層へまとめます。

- ドリルスルー: 集計値の背後にある明細データまでたどります。

特に、ドリルダウンとドリルスルーの違いはよく狙われます。階層を細かくするのがドリルダウン、集計の裏にある明細を見るのがドリルスルーです。

ビッグデータとデータ処理技術

ビッグデータは、単に件数が多いデータではありません。代表的には3Vで整理します。

- Volume: 量が大きいことです。

- Variety: 形式が多様であることです。

- Velocity: 高速に発生し、処理の即時性が求められることです。

対象には、売上表のような構造化データだけでなく、ログ、画像、音声、動画、SNS投稿、センサーデータなどの非構造化データも含まれます。

関連技術も頻出です。

- Webスクレイピング: Webサイトから必要なデータを自動抽出します。

- ストリームデータ処理: 到着し続けるデータを逐次処理します。

- 複合イベント処理: 複数イベントの順序や組み合わせから意味のあるパターンを検出します。

- 形態素解析: 日本語テキストを意味のある最小単位に分けます。

- インメモリ処理: 主にメモリ上で処理して高速化します。

ここでは「どこから取るのか」「逐次かまとめてか」「イベントの関係を見るのか」「文字列を分解するのか」という観点で区別すると誤りにくいです。

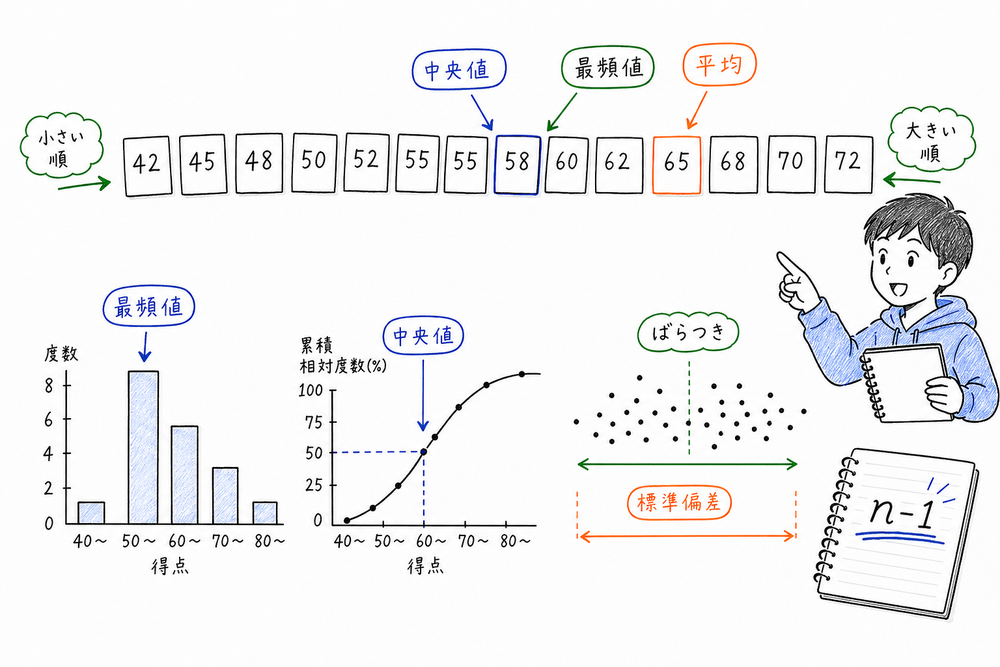

代表的な統計量

統計の基礎では、まず代表値とばらつきを押さえます。

- 平均値: 合計をデータ数で割った値です。

- 中央値: 並べたとき中央にある値です。

- 最頻値: 最も頻度が高い値や階級です。

- 分散: ばらつきの大きさを表します。

- 標準偏差: 分散の平方根で、元の単位系に戻したばらつきです。

試験では、度数分布表や累積相対度数分布表から最頻値と中央値を読む問題が出ます。判断軸はシンプルです。

- 最頻値は、相対度数が最大の階級 を見ます。

- 中央値は、累積相対度数が50%を初めて超える階級 を見ます。

また、標本から母分散を推定するときは不偏分散を使います。不偏分散は偏差平方和を n-1 で割る点が重要です。ここを n で割る誤りは頻出です。

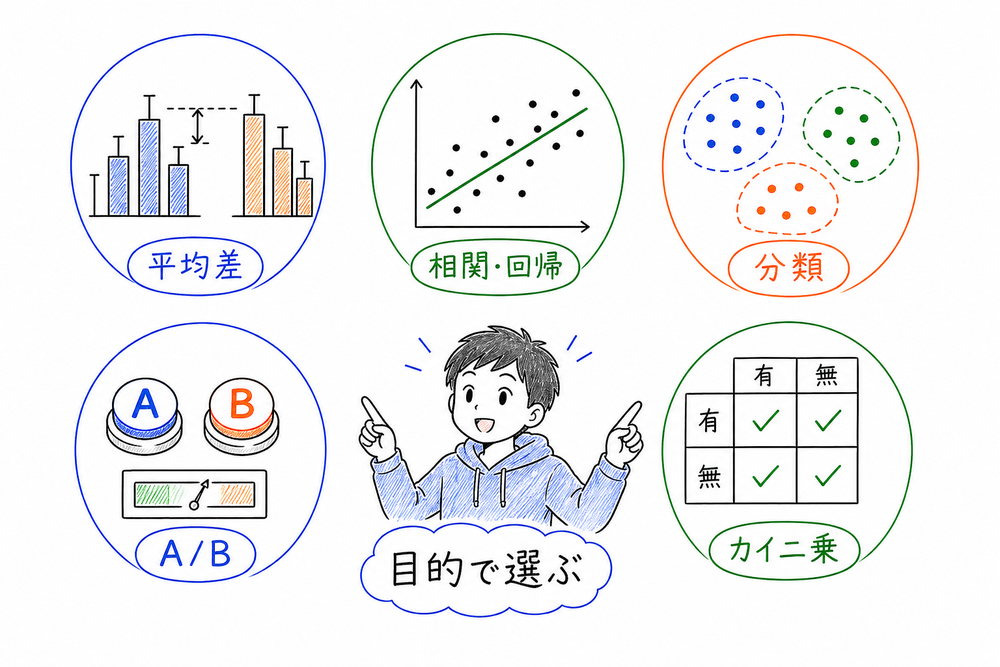

代表的な統計手法

統計手法は、目的と対応づけて覚えるのが最短です。

- 相関分析: 2変数の関係の強さを見ます。

- 回帰分析: 目的変数を説明変数で説明したり予測したりします。

- 重回帰分析: 複数の説明変数で目的変数を説明します。

- 分散分析: 複数群の平均差を見ます。

- t検定: 主に2群の平均差や係数の有意性を見ます。

- F検定: 分散分析や分散の比較で使います。

- カイ二乗検定: クロス集計表で独立性や適合度を見ます。

- クラスター分析: 似た特徴を持つもの同士にグループ分けします。

- 判別分析: 新しいデータがどの群に属するかを判定します。

- コンジョイント分析: 商品属性の組み合わせに対する選好を分析します。

- A/B分析: 2つの施策や画面を比較し、反応差を調べます。

判断のしかたは次のように覚えると使いやすいです。

- 平均差を比べたいなら分散分析やt検定です。

- 関係性や寄与度を見たいなら相関分析や回帰分析です。

- 分類したいならクラスター分析や判別分析です。

- 2案を比べたいならA/B分析です。

- 度数表の独立性を見たいならカイ二乗検定です。

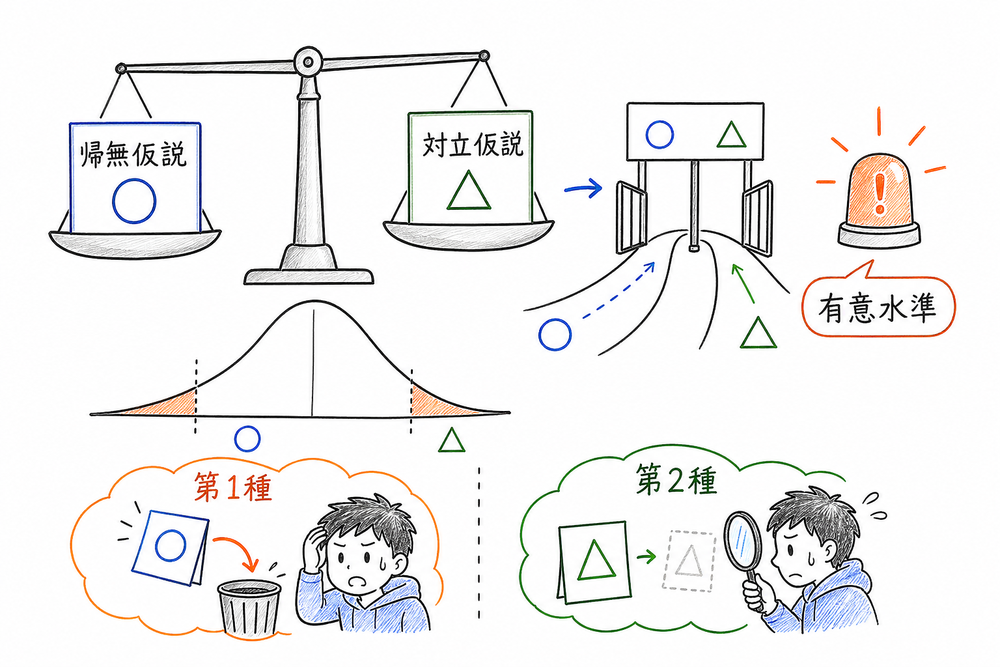

仮説検定の基本

仮説検定では、用語の定義がそのまま問われます。

- 帰無仮説: 差がない、効果がない、関連がないといった、いったん置く仮説です。

- 対立仮説: 帰無仮説に対して、差がある、効果がある、関連があるとする仮説です。

- 有意水準: 第1種の過誤を犯す確率の上限です。

- 第1種の過誤: 本当は帰無仮説が正しいのに棄却してしまう誤りです。

- 第2種の過誤: 本当は帰無仮説が誤っているのに棄却できない誤りです。

ここは日本語でそのまま言い換えて確認すると取り違えにくいです。

- 真なのに捨てるのが第1種です。

- 偽なのに捨てられないのが第2種です。

また、相関係数や回帰係数、一元配置分散分析、クロス集計表など、対象ごとに使う検定が違う点もよく問われます。

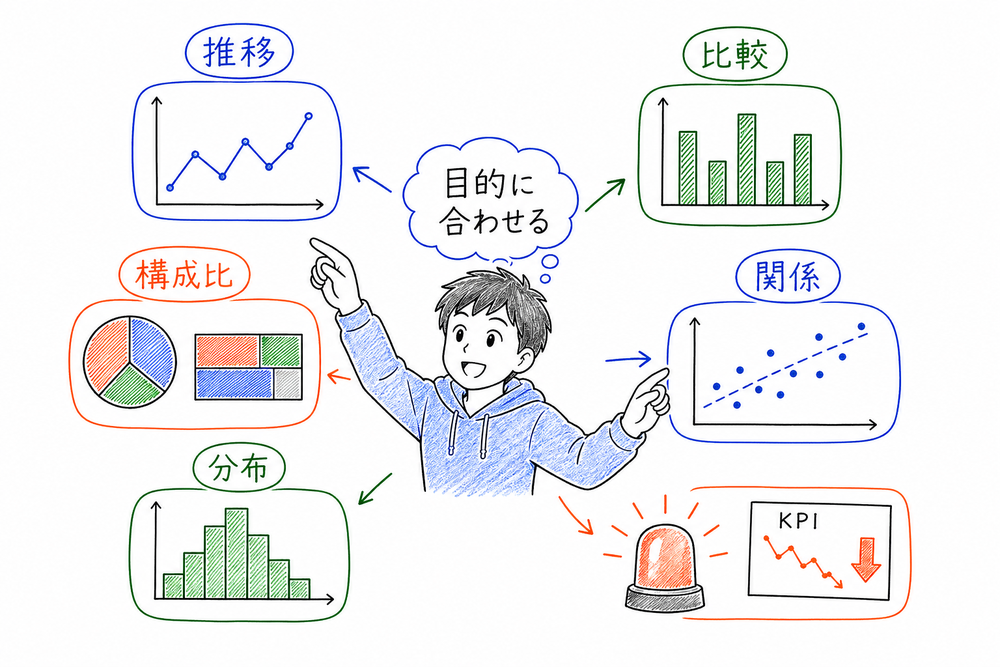

可視化の基本

可視化の目的は、きれいな図を作ることではなく、傾向、異常、比較、分布、構成比を素早く読み取れるようにすることです。

代表的な対応は次のとおりです。

- 折れ線グラフ: 時系列の推移を見ます。

- 棒グラフ: 数量比較をします。

- 円グラフ、積み上げ棒グラフ: 構成比を見ます。

- 散布図: 2変数の関係を見ます。

- ヒストグラム: 分布の形を見ます。

BIツールでは、こうしたグラフをダッシュボードにまとめ、KPIの変化や異常値を早く発見することが重視されます。試験では、グラフの読み取りだけでなく、「どのグラフが目的に合うか」も判断対象になります。

この章のまとめ

- BIは、分析結果を経営判断へつなげるための仕組みです。

- DWHは分析用の統合基盤、データマートは用途別の切り出しです。

- データレイクは多様な生データの蓄積基盤で、管理不全になるとデータスワンプになります。

- ETLは抽出、変換、格納の流れであり、データクレンジングはその中の品質改善作業です。

- OLTPは更新中心の業務処理、OLAPは集計中心の分析処理です。

- ROLAP、MOLAP、HOLAPは実現方式の違いであり、スライシングやドリルダウンは分析操作です。

- ビッグデータは3Vで整理し、非構造化データも含めて考えます。

- 統計手法は、平均差、関係、予測、分類、施策比較のどれを知りたいかで選びます。

- 仮説検定では、帰無仮説、有意水準、第1種の過誤、第2種の過誤を定義どおりに答えられるようにします。

- 相対度数分布では最頻値、累積相対度数分布では中央値を読む、という基本を確実にします。

- 不偏分散は分母が n-1 です。計算問題ではここが最重要です。

一次試験過去問での出方

2010年第20問ではBIの定義が問われ、意思決定支援の仕組みであることを正しく押さえられるかが問われました。

2011年第15問と2023年第1回第16問では、ROLAP、MOLAP、HOLAPと、ダイシング、ドリルスルーなどのOLAP用語が出題されました。方式と操作を分けて整理しておく必要があります。

2013年第15問ではビッグデータの特徴、2017年第14問と2023年第2回第9問では、Webスクレイピング、ETL、ストリーム処理、複合イベント処理、形態素解析などの処理技術の違いが問われました。

2019年第16問ではDWH、データクレンジング、OLAP、2025年第16問ではETL、OLTP、OLAP、データマート、データレイク、データスワンプまで含めたデータ活用基盤の整理が問われました。

2020年第24問では、分散分析、回帰分析、クラスター分析、A/B分析を、分析目的に応じて選び分ける問題が出ました。

2021年第24問では、相関係数、クロス集計表、偏回帰係数、一元配置分散分析に対応する検定方法として、t検定、カイ二乗検定、F検定を切り分ける問題が出ました。

2022年第23問では第1種の過誤、第2種の過誤、有意水準、2022年第24問と2023年第2回第20問では不偏分散が問われ、定義と計算手順の両方が確認されました。

2024年第22問では、相対度数分布と累積相対度数分布から最頻値と中央値を読む問題が出ました。可視化はグラフの名前だけでなく、読み方まで問われます。